Kromě této potenciálně obrovské změny je fascinující i tempo, kterým se celá oblast vyvíjí, a množství novinek, které se objevují každý den. Proto jsme se rozhodli vytvořit nový AI newsletter, který jsme vyčlenili z našeho měsíčníku App News. V AI News se pokusíme zpřehlednit, co se za poslední období událo a jak tyto změny vnímáme z hlediska dopadu na naši práci.

TL;DR

- OpenAI představilo špičkový model GPT-4o, který pracuje s textem, zvukem a obrazem, což umožňuje přirozenější interakci s počítačem.

- Na Google I/O ukázali AI integraci do vyhledávání a projekt Astra, který zpracovává vizuální a zvukové podněty v reálném čase. Představili také nové modely Gemini a PaliGemma.

- Microsoft Build odhalil nové Copilot+ PC s AI integrací a open-source modely Phi-3, včetně multimodálního vision modelu.

Novinky

Poslední měsíc byl plný významných událostí, kde své novinky představily OpenAI, Google i Microsoft. Pojďme se na to podívat postupně.

OpenAI Spring Update

Asi největší novinkou, kterou OpenAI představilo, je uvedení modelu GPT-4o. „O“ je zkratkou pro omni, což znamená, že model je od základu trénovaný na práci nejen s textem, ale i se zvukovými a obrazovými daty. Podle benchmarků se jedná o špičkový model téměř ve všech disciplínách. Díky své rychlosti a schopnosti generovat a zpracovávat text dokáže udržovat konverzaci velmi přirozeně, což otevírá možnosti pro jednodušší interakci mezi člověkem a počítačem.

OpenAI představilo integraci tohoto modelu v rámci aplikace ChatGPT, kde můžete konverzaci přerušit nebo doplnit nové informace. Během demonstrace jsme mohli vidět živý překlad, změnu intonace hlasu nebo dokonce napodobování robotů. Nový model dokáže také zpracovávat vizuální vstup. Aplikace ChatGPT bude přímo zpracovávat i vstup z kamery. I když se zdá, že může zpracovávat přímo video, jedná se o zpracování vybraných obrázků ze streamu. Ukazuje to však, že nové modely mají potenciál lépe vnímat kontext, a tím pádem být mnohem lepší asistenti.

OpenAI tedy představilo nový špičkový model, který je několikanásobně rychlejší než předchozí verze a o polovinu levnější.

Google I/O

Google I/O je každoroční konference, na které Google představuje novinky v rámci svého ekosystému. Stejně jako minulý rok, i letos byla hlavním tématem umělá inteligence. Mezi největší novinky patří AI integrace přímo do vyhledávací funkce, což je jeden z největších updatů této funkce. I když výsledky jsou často sporné kvůli halucinacím, které zatím nelze zcela eliminovat.

Podobně jako OpenAI (načasování před Google I/O bylo jistě jen náhodné), Google představil projekt Astra, který dokáže komunikovat s uživatelem v reálném čase a zpracovávat vizuální i zvukové podněty přímo z mobilní aplikace nebo přes brýle s integrovanou kamerou. Technologii agentů jsme mohli vidět také například v rámci "AI teammates", kteří by měli být schopni automatizovat některé úkoly a odpovídat na e-maily.

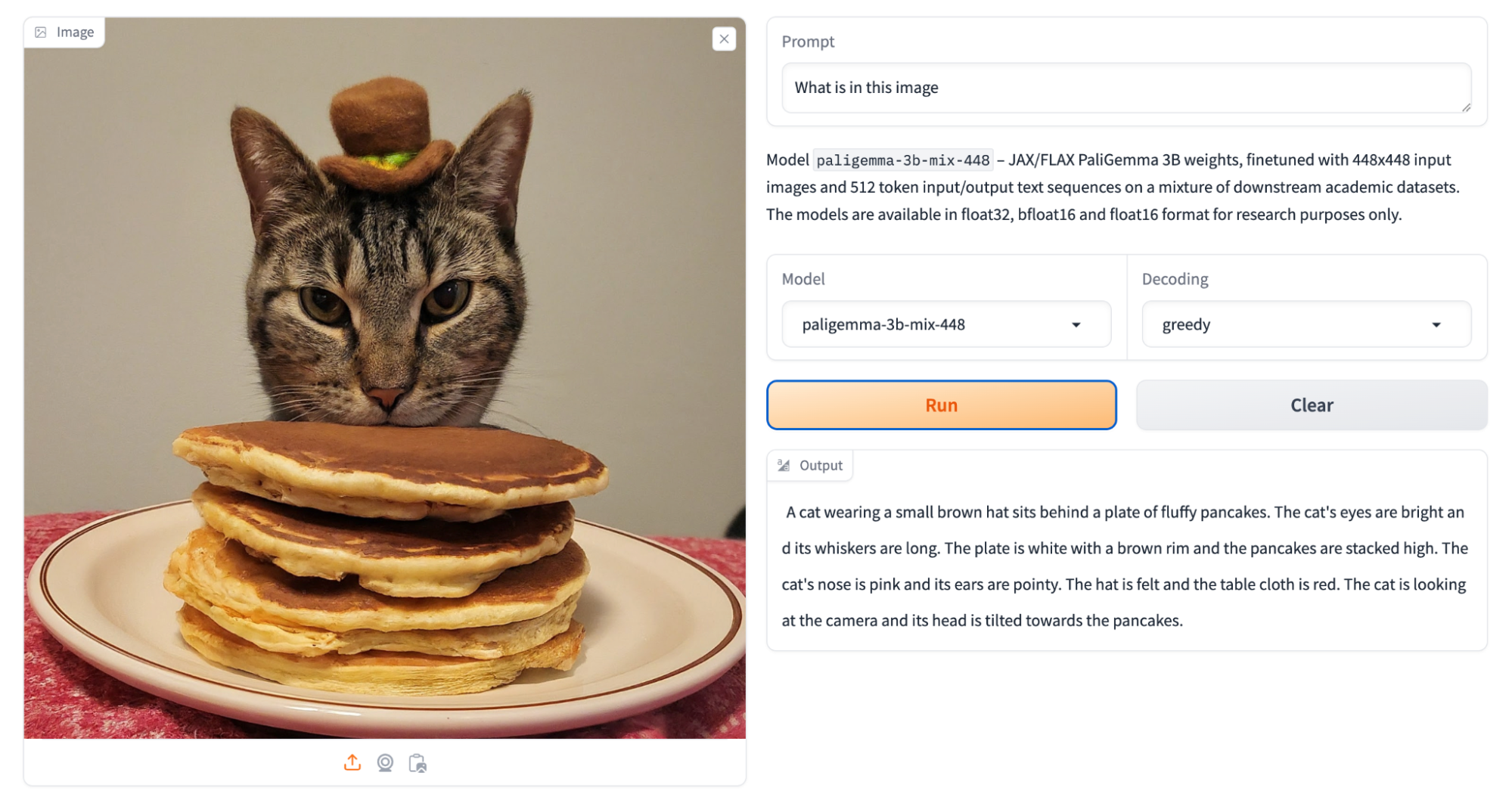

Google také představil novinky ve svých jazykových modelech. Gemini 1.5 Pro je nyní dostupný bez omezení a bylo mu rozšířeno kontextové okno. Do rodiny modelů Gemini 1.5 přibyl i Gemini 1.5 Flash, který je rychlý a relativně levný. Za zmínku stojí nový model pro generování obrázků Imagegen 3 a open-source model Gemma 2, který dosahuje velmi dobrých výsledků v poměru počtu parametrů k výkonu. Novinkou je také nový PaliGemma vision model dostupný v různých velikostech spolu s nástroji pro jednoduchý finetuning, který umožňuje model více specializovat na určité úkoly.

Google také představil VEO, generativní video model, který dokáže vytvářet realistická videa ve vysoké kvalitě. Viděli jsme skutečně zajímavé výsledky, ale podobně jako Sora od OpenAI, bude trvat ještě dlouho, než se tato technologie dostane k běžným uživatelům.

Microsoft Build

Microsoft Build, je každoroční konference, kde Microsoft představuje novinky napříč svou platformou. Mezi nejvýraznější AI novinky patří odhalení nového Copilot+ PC, který má být jedním z nejlepších Windows zařízení s přímou integrací AI. Copilot+ PC obsahuje funkci „recall“, která lokálně nahrává všechny vaše interakce a vidí vše, co vidíte vy. Takže pokud se zeptáte na návrh e-mailu, který jste psali před hodinou a poté ho smazali, recall vám s tím pomůže.

Microsoft také odhalil nové open-source modely v rámci rodiny Phi, které dosahují velmi dobrých výsledků v poměru množství parametrů. Do rodiny Phi přidali také první multimodální vision model.

Zajímavé je také rozšíření Copilot Studio o možnost vytváření Copilot agentů, kteří mohou využívat paměť, učit se ze zpětné vazby a požádat o pomoc.

Co mohou novinky znamenat?

Z novinek, které jsme viděli od OpenAI, Google a Microsoftu, je zřejmé, že kromě vývoje schopnějších jazykových modelů bude hrát v budoucnosti důležitou roli i multimodalita. Dosud jsme považovali za nejefektivnější způsob komunikace s počítačem použití klávesnice a myši. Jak jsme ale mohli vidět v demonstracích OpenAI a Google, přichází doba, kdy nám mohou přibýt nové způsoby interakce. Místo klikání a psaní do aplikací bude možné jednoduše říct, co potřebujete udělat. Celý proces se může zjednodušit na jedno kliknutí a probíhat jako jednoduchá konverzace. AI asistenti, kteří znají systém, ve kterém jsou integrovaní, mají potřebný kontext a jsou dostatečně rychlí na to, aby byli použitelní v reálném čase, nám mohou výrazně usnadnit práci. Místo složitého vyhledávání v dokumentech a přepínání mezi aplikacemi stačí jednoduše říct, co potřebujete.

Proč je rychlá multimodalita tak klíčová?

Dosud jsme měli možnost komunikovat pomocí textového vstupu, což stále platí, ale rychlá interakce připomínající spíše konverzaci otevírá nové možnosti. Představme si pracovníka ve skladu, který místo psaní do mobilu a hledání informací jednoduše řekne, co potřebuje, a během několika sekund dostane odpověď. Tento způsob interakce výrazně zjednodušuje a zrychluje práci.

Automatizace za pomoci vision modelů je výrazně jednodušší než v minulosti. Nové vision modely jako PaliGemma, Phi-3-Vision nebo YOLO (real-time vision) otevírají možnosti detekce a analýzy obrazového vstupu v reálném čase s velmi dobrými výsledky. Umožňují fine-tuning na relativně malém množství dat, což otevírá možnost jejich využití v širokém spektru vizuálních úloh od kontroly kvality, přes real-time analýzu videa až po kontrolu kamerového výstupu.

Zajímavosti

Je GPT-4o skutečně lepší než GPT-4-turbo? Podle tohoto příspěvku na Twitteru se zdá, že GPT-4o je sice rychlejší a levnější než GPT-4-turbo, ale má smíšené hodnocení, protože v některých složitějších úlohách a v dodržování pokynů zaostává, což může vyžadovat úpravy promptů.

Phi-3-Vision překonává větší modely. Zdá se, že model Phi-3-vision překonává v některých vizuálních úlohách i výrazně větší modely jako Claude-3 Haiku a Gemini 1.0 Pro V, jak ukazuje tento příspěvek na Twitteru.

Audio computer. Jason Rugolo představuje v TED Talku koncept „audio computer“ a co to může znamenat pro naši budoucnost. Podívejte se na jeho prezentaci a zjistěte více o tom, proč je audio interface klíčovým prvkem budoucí interakce s technologií.

Výzkum interpretace velkých jazykových modelů. Pokud vás zajímá, jak velké jazykové modely fungují interně, může vás zaujmout následující výzkum od Anthropic. Studie ukázala, že i velké jazykové modely lze částečně interpretovat a že úpravou parametrů lze relativně snadno dosáhnout změn v chování. To může být zajímavou alternativou k fine tuningu. Na 24 hodin bylo dokonce možné otestovat model s upravenými parametry týkajícími se mostu Golden Gate. Pokud jste se zeptali „Kdo jsi?“, místo tradiční odpovědi „Jsem velký jazykový model, který...“ jste dostali popis odpovídající několikatunovému mostu v San Franciscu. Více se dočtete v článku na webu Anthropic.

AI News připravil Martin Sumera.

––

Baví vás, jak o technologiích přemýšlíme? Zajímá vás, jak můžete AI využít pro svůj byznys? Napište Lukášovi Strnadlovi, který Futured založil: [email protected] & +420 605 312 459

Chcete se k nám přidat? Aktuálně hledáme hned několik kolegů. Ozvěte se Míše Kormošové a pobavte se o možnostech spolupráce: [email protected] & +420 739 106 507.